Trong bối cảnh an toàn dữ liệu trở thành ưu tiên hàng đầu, xu hướng đưa AI về vận hành cục bộ (Local AI) đang phát triển mạnh mẽ hơn bao giờ hết. Việc kết hợp Ollama – công cụ chạy các mô hình ngôn ngữ lớn (LLM) mượt mà trên máy tính cá nhân – cùng với OpenClaw sẽ giúp bạn sở hữu một hệ thống AI Agent hoàn toàn riêng tư và mạnh mẽ. Không cần phụ thuộc vào API trả phí hay kết nối internet liên tục, bài viết này sẽ hướng dẫn bạn cách thiết lập bộ đôi hoàn hảo này để tạo ra một trợ lý AI tự trị ngay trên thiết bị của mình.

Tại sao nên kết hợp OpenClaw với Ollama?

Việc hướng dẫn cài đặt OpenClaw kết hợp với Ollama đang trở thành chủ đề “nóng” bởi nó giải quyết triệt để bài toán chi phí và quyền riêng tư. Thay vì phụ thuộc vào bên thứ ba, việc tự vận hành hệ thống AI mang lại 4 lợi ích cốt lõi:

- Tiết kiệm chi phí: Bạn sẽ không còn phải lo lắng về hóa đơn API từ OpenAI hay Anthropic mỗi khi scale hệ thống. Khi chạy local trên VPS/server, chi phí duy nhất bạn trả là tiền thuê VPS/server hàng tháng, bất kể số lượng request là bao nhiêu.

- Bảo mật dữ liệu: Mọi thông tin hội thoại, dữ liệu kinh doanh nhạy cảm đều nằm gói gọn trong server của bạn. Điều này đặc biệt quan trọng với các doanh nghiệp cần tuân thủ nghiêm ngặt về an toàn thông tin, tránh việc dữ liệu bị dùng để huấn luyện mô hình cho các tập đoàn lớn.

- Tốc độ xử lý: Bằng cách đặt server tại các Datacenter trong nước hoặc gần khu vực sử dụng, tốc độ phản hồi sẽ nhanh hơn đáng kể do không phải gửi dữ liệu qua các server quốc tế.

- Khả năng tuỳ biến: Bạn có quyền tự do lựa chọn và thay đổi các model mã nguồn mở hàng đầu hiện nay như Llama 3, Mistral, hay Phi-3. Mỗi model có một thế mạnh riêng và bạn có thể tráo đổi chúng chỉ trong vài giây để phù hợp với từng tác vụ cụ thể.

Yêu cầu hệ thống tối thiểu để chạy mượt mà

Để việc cài đặt Ollama trên và chạy OpenClaw đạt hiệu suất tốt nhất, bạn cần chuẩn bị một cấu hình VPS đủ mạnh:

1. Phần cứng (Hardware)

Để chạy các mô hình ngôn ngữ lớn (LLMs) local, phần cứng cần có khả năng xử lý song song và tốc độ truy xuất dữ liệu cực nhanh. Dưới đây là các thông số bạn cần lưu tâm:

- CPU (Bộ vi xử lý): Tối thiểu 4 Core. AI Agent không chỉ xử lý văn bản mà còn chạy các tác vụ logic của OpenClaw phía sau. Bạn nên ưu tiên các dòng CPU có xung nhịp cao (High-Frequency) để giảm thời gian “suy nghĩ” của model.

- RAM (Bộ nhớ trong):

- 8GB: Mức tối thiểu để chạy model Llama 3 8B ở dạng nén (Quantized).

- 16GB trở lên: Mức “vàng” để hệ thống vừa chạy Ollama, vừa vận hành OpenClaw và các dịch vụ Docker khác mà không bị tràn bộ nhớ.

- GPU (Card đồ họa – Tùy chọn): Đây là “vũ khí” thay đổi cuộc chơi. Nếu có điều kiện, hãy chọn VPS có GPU chẳng hạn như của NVIDIA (VRAM từ 8GB). GPU giúp tăng tốc độ xử lý token nhanh gấp 5-10 lần so với CPU thông thường, mang lại cảm giác phản hồi tức thì như đang chat với ChatGPT.

- Storage (Ổ cứng): Nên sử dụng NVMe SSD với dung lượng trống tối thiểu 20GB để chứa các bản model nặng và đảm bảo tốc độ I/O đọc/ghi dữ liệu mượt mà.

2. Phần mềm (Software)

Một nền tảng phần mềm ổn định và đồng nhất sẽ giúp quá trình cài đặt diễn ra trơn tru, tránh các lỗi xung đột thư viện không đáng có.

- Hệ điều hành: Khuyến nghị sử dụng Ubuntu 22.04 LTS hoặc 24.04 LTS. Đây là môi trường chuẩn nhất cho AI và Docker, sở hữu cộng đồng hỗ trợ lớn và độ tương thích tuyệt vời với driver NVIDIA nếu bạn dùng GPU.

- Trình quản lý container: Hệ thống yêu cầu cài đặt sẵn Docker và Docker Compose. Việc đóng gói OpenClaw vào Docker giúp bạn dễ dàng quản lý, cập nhật hoặc di chuyển server sau này mà không cần cấu hình lại từ đầu.

- Kết nối mạng: Băng thông (Bandwidth) ổn định để tải các bộ model (thường nặng từ 4GB – 10GB) từ thư viện của Ollama một cách nhanh chóng.

Hướng dẫn cài đặt OpenClaw kết hợp với Ollama chi tiết

Việc triển khai hệ thống AI Agent Local không quá phức tạp nếu bạn thực hiện đúng trình tự kỹ thuật. Quy trình này được thiết kế để tách biệt phần “bộ não” (Ollama) và “giao diện điều khiển” (OpenClaw), giúp hệ thống vận hành linh hoạt và dễ dàng bảo trì hoặc nâng cấp sau này. Hãy chuẩn bị quyền Root hoặc Sudo trên server của bạn để bắt đầu.

Bước 1: Cài đặt và cấu hình “bộ não” Ollama

Ollama đóng vai trò là Backend, chịu trách nhiệm tải và chạy các mô hình ngôn ngữ lớn (LLM). Chỉ cần một dòng lệnh duy nhất để hệ thống tự động nhận diện phần cứng và cấu hình môi trường:

curl -fsSL https://ollama.com/install.sh | shSau khi cài đặt xong, hãy tải mô hình Llama 3 (phiên bản 8B) để kiểm tra khả năng xử lý của server:

ollama run llama3Sau khi tải xong, bạn có thể chat thử ngay tại Terminal. Gõ /bye để thoát.

Mặc định Ollama chỉ lắng nghe tại localhost. Để OpenClaw (chạy trong Docker) có thể truy cập được, bạn cần chỉnh sửa file dịch vụ:

sudo systemctl edit ollama.serviceThêm đoạn code sau vào phần cấu hình:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"Sau đó khởi động lại để áp dụng:

sudo systemctl daemon-reload

sudo systemctl restart ollamaBước 2: Triển khai giao diện OpenClaw qua Docker

Tải bản cập nhật mới nhất của OpenClaw về server:

git clone https://github.com/openclaw/openclaw.git

cd openclawTạo một file mang tên docker-compose.yml (nếu chưa có) để định nghĩa cách OpenClaw vận hành. Việc dùng Docker đảm bảo hệ thống của bạn không bị xung đột thư viện với các ứng dụng khác trên VPS. Kích hoạt hệ thống chạy ngầm bằng lệnh:

docker-compose up -dDùng lệnh docker ps để kiểm tra. Nếu trạng thái là Up (healthy), giao diện web của bạn đã sẵn sàng.

Bước 3: Cấu hình kết nối (Chỉnh sửa file .env)

Đây là bước cuối cùng để “ghép nối” giao diện OpenClaw với bộ não Ollama thông qua các biến môi trường. Mở file .env bằng trình soạn thảo (như nano hoặc vim) và điều chỉnh các thông số sau:

- Thiết lập Provider: Tìm dòng PROVIDER và thay đổi giá trị PROVIDER=ollama.

- Cấu hình đường dẫn (Base URL): Trỏ OpenClaw đến địa chỉ của Ollama (OLLAMA_BASE_URL=http://:11434).

*Lưu ý: Nếu chạy cùng một máy, bạn có thể dùng IP nội bộ của Docker hoặc IP Public của VPS.

Đảm bảo tên model trùng khớp với model bạn đã tải ở Bước 1:

OLLAMA_MODEL=llama3Sau khi lưu file, hãy khởi động lại Docker để các thay đổi có hiệu lực:

docker-compose restartChúc mừng, bạn đã sở hữu một hệ thống AI Agent hoàn chỉnh và độc lập!

Kiểm tra hiệu năng và Debug lỗi

Sau khi hoàn tất cài đặt, đừng vội vàng đưa vào sử dụng ngay. Một chuyên gia luôn dành thời gian để “nghiệm thu” hệ thống nhằm đảm bảo mọi thứ vận hành đúng công suất và không có lỗi tiềm ẩn.

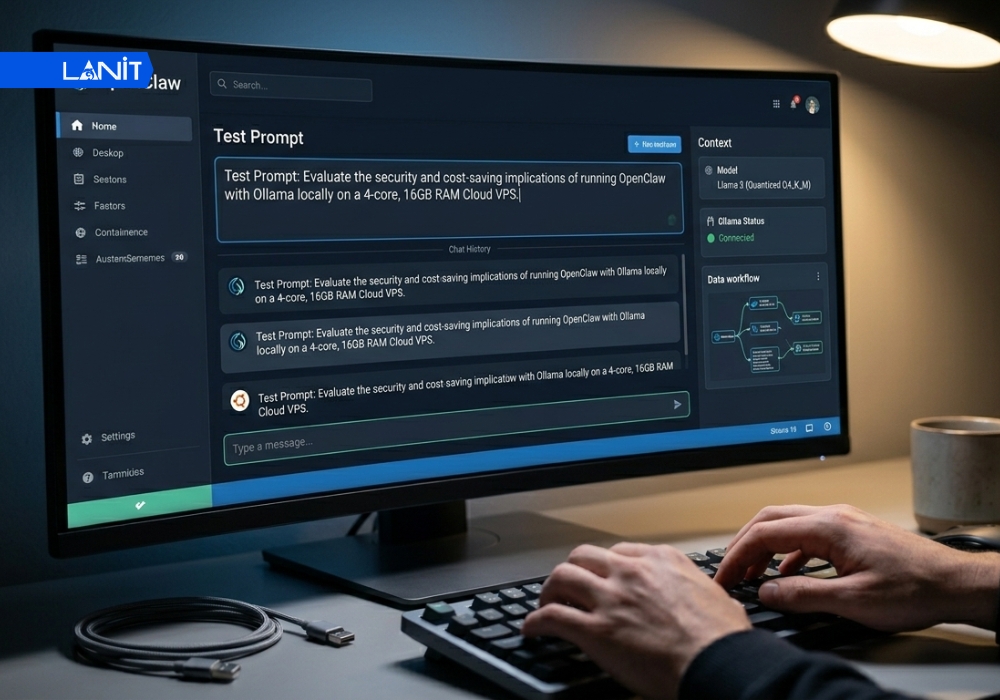

1. Test Promt

Hãy bắt đầu bằng việc đặt câu hỏi cho Agent thông qua giao diện OpenClaw. Bạn nên thử nghiệm với 3 cấp độ:

- Cấp độ dễ: Hỏi về thông tin thực tế (Ví dụ: “Thủ đô của Pháp là gì?”).

- Cấp độ trung bình: Yêu cầu tóm tắt một đoạn văn bản dài khoảng 500 chữ.

- Cấp độ khó: Yêu cầu viết code hoặc giải quyết một bài toán logic.

Nếu AI trả về từng chữ (streaming) mượt mà, hệ thống của bạn đang ổn định.

2. Giám sát tài nguyên

Để biết server có đang bị “hụt hơi” hay không, bạn cần sử dụng các công cụ giám sát thời gian thực:

- Sử dụng htop: Gõ htop trong Terminal để xem CPU và RAM đang bị chiếm dụng bao nhiêu phần trăm (%). Nếu RAM luôn ở mức đỏ (>90%), bạn cần nâng cấp VPS.

- Sử dụng docker stats: Lệnh này giúp bạn soi chi tiết từng Container của OpenClaw đang tiêu thụ bao nhiêu tài nguyên.

3. Các lỗi thường gặp và cách xử lý nhanh

Trong quá trình hướng dẫn cài đặt OpenClaw kết hợp với Ollama, người dùng thường gặp 2 rào cản chính:

- Lỗi “Connection Refused”: 99% nguyên nhân là do bạn chưa mở Port 11434 trên Firewall của VPS hoặc chưa cấu hình OLLAMA_HOST=0.0.0.0. Hãy kiểm tra lại cấu hình ở Bước 1.

- Lỗi phản hồi chậm/treo máy: Thường xảy ra khi bạn chạy model quá lớn (như Llama 3 70B) trên một server chỉ có 8GB RAM. Hãy hạ cấp xuống bản 8B hoặc sử dụng bản nén (Quantized).

Mẹo tối ưu hóa khi chạy OpenClaw Local

Chạy AI trên hạ tầng riêng là một nghệ thuật cân bằng giữa hiệu năng và tài nguyên. Dưới đây là những “tuyệt chiêu” giúp hệ thống của bạn mượt mà hơn mà không tốn thêm chi phí nâng cấp phần cứng.

- Sử dụng Model Quantized: Thay vì dùng bản gốc, hãy chọn các model có hậu tố Q4_K_M hoặc Q5_K_M. Kỹ thuật này giúp giảm dung lượng RAM yêu cầu từ 2-4 lần nhưng vẫn giữ được ~95% độ thông minh của mô hình.

- Cấu hình Swap RAM: Đây là “phao cứu sinh” cho VPS thiếu RAM thực tế. Việc tạo file Swap từ 4GB – 8GB trên ổ cứng NVMe sẽ giúp hệ thống tránh bị sập (Crash) đột ngột khi xử lý các chuỗi hội thoại dài hoặc nạp model nặng.

- Tự động hóa hệ thống:

- Với Ollama: Thiết lập để dịch vụ tự khởi chạy cùng hệ thống (Systemd), đảm bảo AI luôn sẵn sàng ngay sau khi reboot server.

- Với OpenClaw: Sử dụng thuộc tính restart: always trong file docker-compose.yml để các container giao diện tự động phục hồi nếu gặp sự cố phần mềm

Đến đây, bạn đã hoàn thành lộ trình hướng dẫn cài đặt OpenClaw kết hợp với Ollama và biết cách tinh chỉnh để hệ thống chạy ổn định nhất. Việc kết hợp mô hình nén, bộ nhớ ảo và quy trình tự động hóa chính là công thức hoàn hảo để sở hữu một AI Agent chuyên nghiệp với chi phí tối ưu nhất.