Server lag đúng giờ cao điểm, website tải chậm hơn 3 giây, khách hàng thoát trang là nỗi đau thực tế mà nhiều Developer và chủ doanh nghiệp phải đổi mặt hàng ngày. Nguyên nhân không phải lúc nào cũng do cấu hình VPS yếu, đôi khi chỉ vì thiếu tool hỗ trợ tối ưu hoá hệ thống. Bài viết này LANIT tổng hợp các tool tăng tốc Cloud Server được kiểm chứng thực tế, giúp bạn duy trì uptime ổn định mà không cần nâng cấp phần cứng tốn kém.

Tool tối ưu Cloud Server là gì?

Tool tối ưu Cloud Server là tập hợp các phần mềm, tiện ích dòng lệnh và dịch vụ hệ thống được thiết kế để khai thác tối đa hiệu suất của máy chủ ảo. Các công cụ này can thiệp trực tiếp vào các tầng khác nhau của hạ tầng: từ kernel, bộ nhớ RAM, hệ thống file cho đến stack ứng dụng web.

Không giống với việc nâng cấp tài nguyên (scale up), tối ưu hóa bằng tool tập trung vào việc giảm lãng phí tài nguyên hiện có, loại bỏ các tiến trình thừa, nén dữ liệu truyền tải, cache thông minh và điều phối I/O hiệu quả hơn.

Một Cloud Server được tối ưu đúng cách có thể xử lý gấp 2–3 lần lượng request so với cùng cấu hình chạy mặc định. Điều này đã được xác nhận trong nhiều benchmark thực tế trên các hệ thống Linux.

>>> Xem thêm: So sánh Cloud VPS vs Cloud Server chi tiết từ A đến Z

Vì sao nên sử dụng Tool tối ưu Cloud Server

Một Cloud Server chạy mặc định thường chưa được cấu hình cho workload cụ thể của bạn. Kernel parameters, giới hạn file descriptor, TCP buffer size, tất cả đều được đặt ở mức an toàn chung, không phải mức tối ưu.

Hậu quả thực tế bao gồm:

- Latency cao dù bandwidth đủ, do TCP congestion control không phù hợp

- I/O bottleneck khi nhiều tiến trình cùng ghi/đọc disk đồng thời

- RAM bloat từ các dịch vụ chạy ngầm không cần thiết

- Uptime giảm do swap sử dụng quá mức khi memory pressure tăng

Sử dụng đúng tool giúp bạn chẩn đoán chính xác điểm nghẽn (bottleneck) thay vì mò mẫm. Từ đó, mọi quyết định tối ưu hóa đều dựa trên dữ liệu thực, không phải phỏng đoán.

Các Tool tối ưu Cloud Server giúp cải thiện hiệu suất rõ rệt

Các công cụ tối ưu Cloud Server giúp theo dõi tài nguyên, phát hiện điểm nghẽn hệ thống và cải thiện hiệu suất vận hành. Nhờ đó, quản trị viên có thể quản lý CPU, RAM, disk và network hiệu quả hơn trong quá trình vận hành server.

htop/atop hỗ trợ giám sát theo thời gian thực

Trước khi tối ưu bất cứ thứ gì, bạn cần biết Cloud Server đang bị nghẽn ở đâu. htop hiển thị trực quan từng CPU core riêng biệt, mức RAM/swap đang dùng, và danh sách tiến trình được sắp xếp theo mức tiêu thụ tài nguyên, cho phép bạn phát hiện ngay tiến trình nào đang ăn hết CPU hoặc memory chỉ trong vài giây.

atop đi xa hơn ở điểm then chốt: nó ghi log lịch sử tài nguyên theo từng phút, kể cả khi bạn không đang ngồi nhìn màn hình. Khi Cloud Server xảy ra sự cố lúc 3 giờ sáng, bạn có thể mở atop vào sáng hôm sau và replay lại toàn bộ diễn biến — xem chính xác tiến trình nào spike CPU, disk I/O đạt đỉnh lúc mấy giờ, network throughput thay đổi ra sao. Đây là thứ htop không làm được.

Netdata giám sát chi tiết thông qua dashboard

Netdata là công cụ giám sát mã nguồn mở thu thập hơn 2.000 metric hệ thống mỗi giây và hiển thị lên dashboard web real-time. Điểm khác biệt so với các công cụ tương tự là Netdata hoạt động hoàn toàn on-agent, không cần dữ liệu lên cloud bên ngoài hay cấu hình phức tạp.

Tuned – tự động tối ưu Kernel theo Profile

Linux kernel có hàng trăm parameter ảnh hưởng đến hiệu suất, từ cách scheduler phân bổ CPU time, cách quản lý dirty page cache, cho đến power management của CPU. Cấu hình mặc định được thiết kế cho compatibility tối đa, không phải performance tối đa.

tuned giải quyết điều này bằng cách gom các tham số tối ưu theo từng use case vào profile định sẵn. Khi áp dụng một profile, tuned tự động điều chỉnh hàng chục kernel parameter cùng lúc mà không cần bạn phải biết từng tham số là gì.

Các profile quan trọng nhất:

| Profile | Phù hợp với | Tác động chính |

| throughput-performance | Web server, file server | Tối đa hóa I/O throughput, tắt power saving |

| latency-performance | Game server, trading app | Giảm CPU latency, tắt C-states |

| network-latency | Proxy, real-time app | Tối ưu TCP stack cho latency thấp |

| network-throughput | Media streaming, CDN node | Tối đa hóa bandwidth |

| virtual-guest | Cloud Server/VM | Tối ưu cho môi trường ảo hóa |

BBR Congestion Control

BBR là thuật toán điều khiển tắc nghẽn TCP do Google Research phát triển và tích hợp vào Linux kernel từ phiên bản 4.9. Thuật toán mặc định CUBIC hoạt động theo nguyên tắc reactive (tăng tốc độ gửi cho đến khi phát hiện packet loss, sau đó giảm mạnh). Cách tiếp cận này gây ra latency cao và throughput không ổn định, đặc biệt trên đường truyền có packet loss tự nhiên hoặc RTT cao.

BBR hoạt động theo nguyên tắc khác: thay vì phản ứng với packet loss, BBR liên tục ước tính bandwidth thực sự khả dụng và RTT tối thiểu của đường truyền, từ đó điều chỉnh tốc độ gửi để luôn gần với giá trị tối ưu mà không gây tắc nghẽn. Kết quả là throughput cao hơn và latency ổn định hơn, ngay cả khi có packet loss ở mức 1–5%.

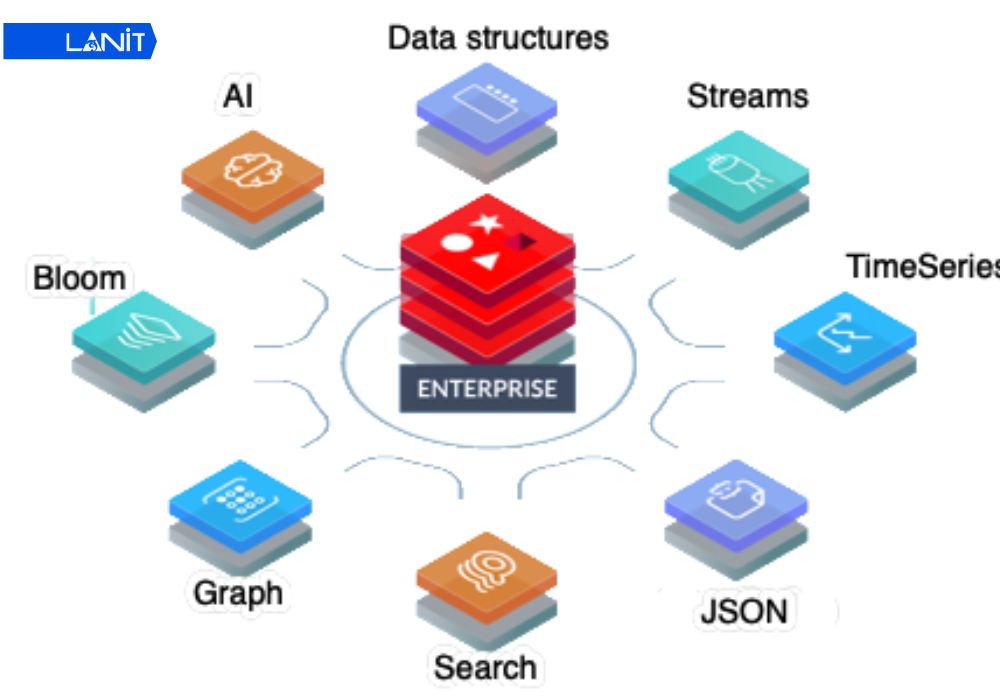

Redis – In-Memory Cache giúp giảm tải Database

Trong nhiều ứng dụng web, mỗi request thường phải truy vấn trực tiếp vào database. Quy trình này bao gồm phân tích câu lệnh SQL, tìm dữ liệu trên disk và trả kết quả về ứng dụng, khiến thời gian xử lý mỗi truy vấn có thể kéo dài vài mili-giây. Khi lưu lượng truy cập tăng cao, database dễ trở thành điểm nghẽn của toàn hệ thống.

Redis giải quyết vấn đề này bằng cách hoạt động như một lớp cache trong bộ nhớ (RAM) nằm giữa ứng dụng và database. Khi một truy vấn được thực hiện lần đầu, kết quả có thể được lưu vào Redis với thời gian tồn tại (TTL) xác định. Những request tiếp theo có cùng dữ liệu sẽ được trả về trực tiếp từ bộ nhớ, giúp giảm đáng kể thời gian phản hồi và hạn chế số lần truy vấn vào database.

Ngoài vai trò caching, Redis còn được sử dụng cho nhiều mục đích khác như lưu session người dùng, triển khai cơ chế rate limiting cho API hoặc làm hàng đợi thông điệp đơn giản trong kiến trúc ứng dụng.

Nginx + FastCGI Cache

FastCGI Cache là cơ chế cache tích hợp trong Nginx, hoạt động ở tầng web server trước khi request được chuyển đến PHP-FPM. Khi một trang được truy cập lần đầu, Nginx sẽ xử lý request, chuyển tới PHP để tạo nội dung HTML hoàn chỉnh, sau đó lưu kết quả này vào bộ nhớ cache trên disk.

Ở các request tiếp theo đến cùng URL, Nginx có thể trả về trực tiếp file HTML đã được cache mà không cần khởi động PHP engine hoặc truy vấn database. Nhờ vậy, thời gian phản hồi của website có thể giảm đáng kể và hiệu suất phục vụ request gần tương đương với việc trả về một file tĩnh.

FastCGI Cache thường được so sánh với Redis cache nhưng hai cơ chế này hoạt động ở các tầng khác nhau. FastCGI Cache nằm ở layer web server (Nginx) và lưu nội dung trang trên disk, trong khi Redis thường được sử dụng ở layer ứng dụng để cache dữ liệu hoặc query trong bộ nhớ RAM. Khi kết hợp cả hai, hệ thống có thể tạo ra nhiều lớp cache khác nhau, giúp giảm tải cho application và database trong các thời điểm traffic tăng cao.

>>> XEM THÊM: Website VPS có những lợi ích gì? Website nào nên dùng VPS?

Lưu ý quan trọng khi dùng tool tăng tốc Cloud Server

Việc sử dụng các công cụ tối ưu hiệu suất có thể giúp Cloud Server hoạt động nhanh và ổn định hơn. Tuy nhiên, nếu triển khai không đúng cách, các thay đổi về cấu hình hệ thống hoặc network có thể gây ảnh hưởng trực tiếp đến hoạt động của dịch vụ. Vì vậy, cần thực hiện từng bước có kiểm soát và theo dõi kỹ sau mỗi lần điều chỉnh.

- Không áp dụng nhiều tool cùng lúc: Mỗi thay đổi cấu hình nên được triển khai và kiểm tra riêng lẻ. Việc áp dụng đồng thời nhiều công cụ tối ưu có thể gây khó khăn khi xác định nguyên nhân nếu hệ thống phát sinh lỗi hoặc hiệu suất không đạt như mong muốn.

- Sao lưu cấu hình trước khi chỉnh sửa: Trước khi thay đổi các file cấu hình hệ thống như

sysctl.conf,nginx.confhoặc các tham số kernel, cần tạo bản sao lưu để có thể khôi phục khi cần thiết. Một lỗi cấu hình nhỏ có thể khiến server mất kết nối mạng hoặc dịch vụ không khởi động được. - Kiểm thử trên môi trường staging trước khi áp dụng production: Các thay đổi như kích hoạt BBR, sử dụng tuned profile hoặc cấu hình Nginx cache có thể ảnh hưởng đến cách ứng dụng xử lý request. Vì vậy nên kiểm thử trên môi trường staging trước khi triển khai trên hệ thống production.

- Theo dõi hệ thống sau khi tối ưu: Sau mỗi lần thay đổi cấu hình, cần giám sát hiệu suất server trong khoảng 24–48 giờ để đánh giá tác động thực tế. Các công cụ như Netdata hoặc atop có thể giúp theo dõi CPU, RAM, I/O và network để phát hiện sớm các vấn đề phát sinh.

Những cách tối ưu Cloud Server khác để tăng hiệu quả bền vững

Bên cạnh việc sử dụng các tool tối ưu hệ thống, một số cấu hình ở cấp độ kernel và hệ điều hành cũng đóng vai trò quan trọng trong việc duy trì hiệu suất Cloud Server ổn định lâu dài. Những tinh chỉnh này giúp giảm tải tài nguyên, hạn chế I/O không cần thiết và tối ưu khả năng sử dụng RAM – đặc biệt hiệu quả với các server có tài nguyên hạn chế.

Tối ưu Swap và Memory Management

Một trong những nguyên nhân khiến Cloud Server hoạt động chậm là việc hệ thống sử dụng swap quá nhiều. Khi kernel ghi dữ liệu từ RAM ra ổ đĩa (swap), tốc độ xử lý sẽ giảm đáng kể vì tốc độ disk luôn chậm hơn RAM.

Bạn có thể giảm mức độ sử dụng swap bằng cách điều chỉnh tham số swappiness trong kernel.

# Giảm swappiness (mặc định 60, nên đặt 10–20 cho server) echo "vm.swappiness=10" >> /etc/sysctl.conf # Tối ưu dirty ratio để giảm I/O spikes echo "vm.dirty_ratio=15" >> /etc/sysctl.conf echo "vm.dirty_background_ratio=5" >> /etc/sysctl.conf sysctl -p

Việc giảm swappiness giúp hệ thống ưu tiên giữ dữ liệu trong RAM thay vì ghi ra swap. Điều này đặc biệt hữu ích với Cloud Server sử dụng SSD hoặc NVMe, giúp giảm thời gian chờ I/O và cải thiện tốc độ phản hồi của ứng dụng.

Vô hiệu hoá các dịch vụ không cần thiết

Nhiều hệ điều hành cài đặt sẵn các service nền mà server thực tế không sử dụng. Những dịch vụ này vẫn tiêu thụ RAM, CPU và đôi khi còn tạo ra các tiến trình I/O không cần thiết.

Bạn nên kiểm tra và tắt các service không dùng đến.

# Xem danh sách service đang chạy

systemctl list-units --type=service --state=running

# Tắt các service không dùng

sudo systemctl disable --now bluetooth

sudo systemctl disable --now cupsTrên các Cloud Server có dung lượng RAM nhỏ (ví dụ 2GB), việc loại bỏ các service dư thừa có thể giải phóng 200–400MB RAM, giúp hệ thống dành nhiều tài nguyên hơn cho ứng dụng chính như web server, database hoặc container.

Sử dụng hệ thống file phù hợp với Workload

Lựa chọn filesystem phù hợp cũng ảnh hưởng trực tiếp đến hiệu suất lưu trữ của Cloud Server.

Một số hệ thống file phổ biến gồm:

- ext4: ổn định, phù hợp với hầu hết workload server

- XFS: tối ưu cho việc ghi dữ liệu lớn liên tục

- Btrfs: hỗ trợ snapshot và compression nhưng tiêu tốn CPU nhiều hơn

Ngoài ra, bạn có thể tối ưu thêm bằng cách sử dụng option noatime khi mount ổ đĩa.

Ví dụ cấu hình trong /etc/fstab:

UUID=xxxx / ext4 defaults,noatime 0 1Tùy chọn này giúp hệ thống không cập nhật timestamp mỗi lần đọc file, từ đó giảm số lần ghi không cần thiết lên ổ đĩa. Trong một số workload web hoặc database, điều này có thể giúp giảm 10–20% I/O write.

Chọn hạ tầng Cloud Server có hiệu năng cao

Việc tối ưu phần mềm sẽ phát huy hiệu quả tốt nhất khi đi kèm với hạ tầng cloud có chất lượng cao. Nếu nền tảng lưu trữ hoặc mạng chậm, các tối ưu ở cấp hệ điều hành cũng khó mang lại cải thiện đáng kể.

Khi lựa chọn Cloud Server, bạn nên ưu tiên các yếu tố như:

- Ổ cứng NVMe SSD cho tốc độ đọc ghi cao

- Mạng tốc độ cao (10Gbps) để giảm latency

- Hypervisor KVM để đảm bảo hiệu năng gần với máy vật lý

Một nền tảng hạ tầng tốt sẽ giúp các cấu hình tối ưu và công cụ monitoring hoạt động hiệu quả hơn, từ đó mang lại hiệu suất ổn định và bền vững cho hệ thống.

Tăng tốc Cloud Server không phải là bài toán một bước. Đó là quá trình chẩn đoán, tối ưu, đo lường, lặp lại với từng lớp hạ tầng. Bắt đầu từ giám sát (htop, Netdata), xác định bottleneck, sau đó áp dụng có chọn lọc các tool phù hợp với workload thực tế của bạn.

Tuy nhiên, mọi nỗ lực tối ưu phần mềm đều có giới hạn nếu nền tảng Cloud Server bên dưới không đủ mạnh. LANIT cung cấp dịch vụ Cloud Server với hạ tầng NVMe SSD tốc độ cao, mạng nội địa latency thấp, uptime cam kết 99.9% và đội ngũ hỗ trợ kỹ thuật 24/7 nền tảng lý tưởng để mọi công cụ tối ưu hóa trên đây phát huy tối đa hiệu quả.